Descubre por qué la IA local supera a la nube. Privacidad total, velocidad extrema y los mejores modelos para ejecutar en tu dispositivo hoy mismo.

La IA local en dispositivos: por qué es la gran tendencia frente a la nube

La tecnología está cambiando rápido. Antes, todo sucedía en grandes servidores. Ahora, el poder regresa a tus manos. La IA local está transformando cómo usamos la tecnología. Ya no dependemos siempre de internet.

Los gigantes tecnológicos lo saben. Apple, Google y Samsung apuestan por esto. Quieren que tu teléfono piense por sí mismo. Esto se llama «Edge AI» o inteligencia en el borde. Es un cambio fundamental. Afecta a la privacidad, la velocidad y el consumo de energía.

En este artículo , analizaremos este fenómeno. Veremos por qué tu próximo móvil debe estar preparado. También revisaremos los modelos más potentes que puedes usar hoy.

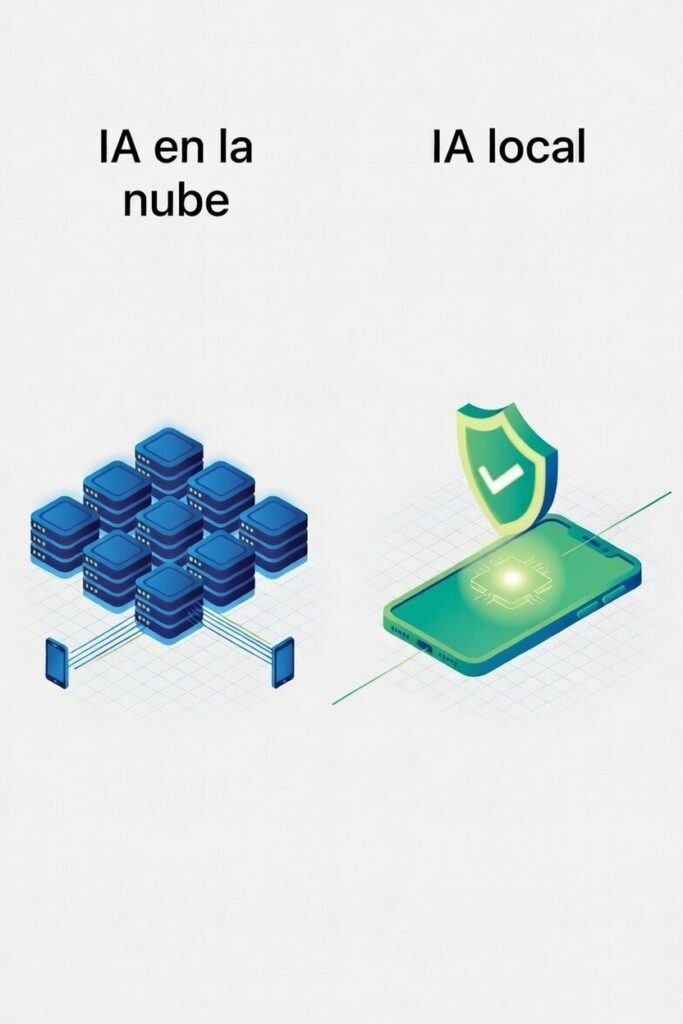

¿Qué es exactamente la IA local y cómo funciona?

La IA local es procesar datos en tu propio equipo. No envía la información a la nube. Todo ocurre en el procesador de tu móvil o PC.

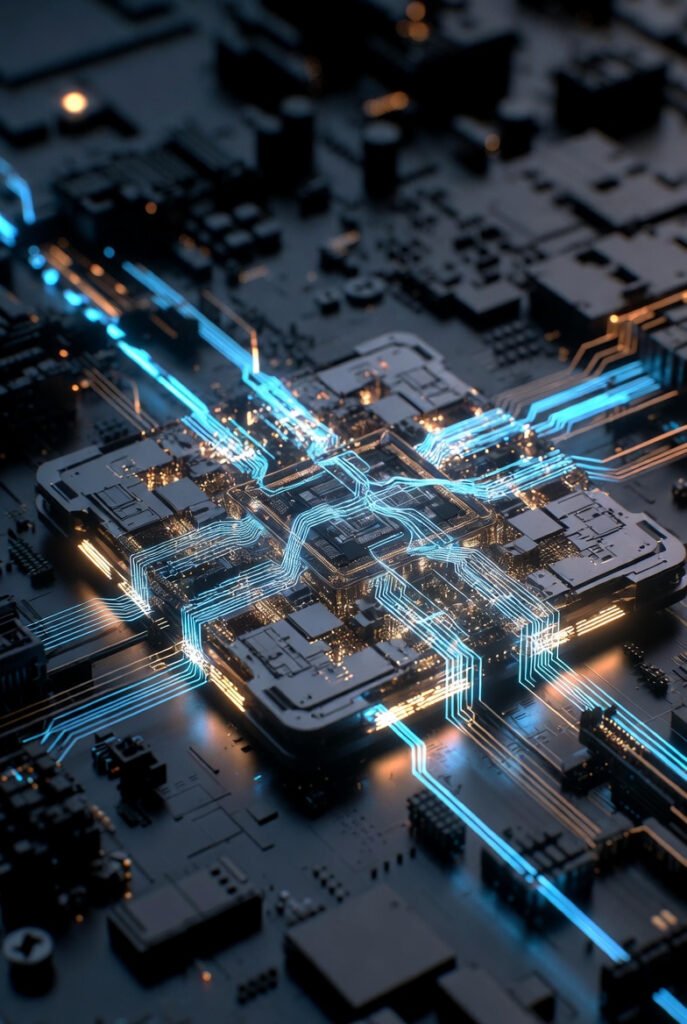

Hasta hace poco, esto era difícil. Los modelos de inteligencia artificial eran gigantes. Necesitaban superordenadores para funcionar. Pero la tecnología ha avanzado. Ahora tenemos chips especializados. Se llaman NPU (Unidades de Procesamiento Neuronal).

Estos chips están diseñados para una tarea. Ejecutan redes neuronales de forma eficiente. No gastan tanta batería como un procesador normal. Esto permite tener asistentes inteligentes sin conexión.

El cambio de paradigma: De la Nube al Borde

Imagina hablar con un asistente. En el modelo antiguo, tu voz viaja kilómetros. Llega a un servidor, se procesa y vuelve. Esto tarda tiempo. Además, tus datos salen de tu control.

Con la IA local, tu voz no sale de tu casa. El teléfono procesa la orden al instante. Es como tener un cerebro digital en el bolsillo.

Ventajas de la Inteligencia Artificial local frente a la nube

La nube sigue siendo útil. Pero la ejecución local gana en áreas críticas. Vamos a desglosar los beneficios principales.

Privacidad y seguridad de datos

Este es el punto más fuerte. Cuando usas ChatGPT en la web, envías datos. Esos datos pueden ser usados para entrenar modelos. A muchas empresas esto les preocupa.

Con una IA local, tus datos son tuyos. Nunca salen del dispositivo. Puedes analizar documentos financieros sin riesgo. Puedes editar fotos personales sin subirlas a ningún lado. La privacidad es total. Es ideal para entornos médicos o legales.

Latencia cero y funcionamiento offline

La velocidad importa. A veces, la conexión a internet falla. O es lenta. La IA local no necesita señal. Funciona en un avión o en el metro.

La respuesta es inmediata. No hay «lag» de red. Esto es vital para coches autónomos. También para traducción en tiempo real. La fluidez mejora la experiencia de usuario drásticamente.

Eficiencia energética y costes

Los centros de datos consumen mucha energía. Tienen una huella de carbono enorme. Mover datos por la red también gasta electricidad.

Procesar datos en el origen ahorra energía. Tu batería sufre menos que transmitiendo datos constantemente. Además, reduce el coste de suscripciones a servicios en la nube. A largo plazo, es más sostenible.

Hardware para IA en el dispositivo: Marcas líderes

No todos los dispositivos pueden con esto. Se necesita hardware específico. Las marcas están en una carrera feroz. Aquí están los líderes actuales.

Apple Silicon (Serie M y A Pro)

Apple lleva ventaja aquí. Sus chips tienen el «Neural Engine». Desde el chip A17 Pro y la serie M4, son bestias. Están optimizados para «Apple Intelligence». Permiten ejecutar modelos complejos en iPads y MacBooks con soltura. Su integración de software y hardware es excelente.

Qualcomm Snapdragon (X Elite y 8 Gen 3/4)

Qualcomm ha dado un golpe en la mesa. El Snapdragon X Elite para portátiles es revolucionario. Tiene una NPU capaz de 45 TOPS (billones de operaciones por segundo). Esto habilita las funciones de Copilot+ en Windows. En móviles, el Snapdragon 8 Gen 3 permite IA local generativa de imágenes en segundos.

Google Tensor (G4 y posteriores)

Google diseña sus chips para la IA. Los Pixel usan los chips Tensor. No son los más rápidos en fuerza bruta. Pero son los más inteligentes. Están hechos para ejecutar los modelos Gemini Nano de forma nativa. Optimizan la fotografía y la traducción como nadie.

NVIDIA (Serie RTX 40 y 50)

En PC de escritorio, NVIDIA reina. Sus tarjetas gráficas tienen núcleos Tensor. Son el estándar de oro. Si quieres ejecutar modelos grandes localmente, necesitas una RTX. Ofrecen la mayor potencia para entusiastas y desarrolladores.

Modelos de IA local

El hardware es el cuerpo. El modelo es el cerebro. Gracias a la comunidad Open Source, hay opciones increíbles. Puedes descargarlos en sitios como Hugging Face. Aquí están los mejores modelos optimizados para correr en local.

Llama 3 (Meta)

Meta cambió el juego. Llama 3 es increíblemente potente. La versión de 8 mil millones de parámetros (8B) es perfecta para consumo local.Se trata de una inteligencia artificial avanzada que impulsa el asistente Meta AI en Facebook, WhatsApp e Instagram, permitiendo generar texto, imágenes y realizar razonamientos complejos de manera gratuita.

- Por qué destaca: Razonamiento lógico superior y gran capacidad de redacción.

- Requisitos: Funciona bien en portátiles modernos y móviles de gama alta.

Phi-3.5 (Microsoft)

Microsoft ha hecho magia. Phi-3 es un modelo «pequeño». Pero rinde como uno grande.

- Por qué destaca: Está entrenado con datos de «libros de texto». Es muy inteligente para su tamaño.

- Uso ideal: Dispositivos móviles y tareas de resumen rápido.

Gemma 2 (Google)

Google liberó Gemma. Está basado en la tecnología de Gemini.

- Por qué destaca: Es ligero y eficiente. Tiene variantes muy pequeñas (27B y 9B).

- Ventaja: Se integra muy bien con herramientas de desarrollo como Keras.

Mistral (Mistral AI)

El orgullo europeo. Mistral ofrece modelos muy eficientes. Mistral NeMo es una colaboración con NVIDIA.

- Por qué destaca: Es muy flexible. Tiene una ventana de contexto grande. Recuerda mucha información de la conversación.

Cómo ejecutar estos modelos

Usar IA local hoy es tan fácil como instalar WhatsApp o un videojuego.

Para entenderlo, usa esta analogía:

- El Modelo (Llama 3, Phi-3): Es como un archivo de música (MP3). Contiene la «inteligencia».

- El Programa (LM Studio, GPT4All): Es como el reproductor de música (Spotify o Windows Media). Es la aplicación que te permite usar ese archivo.

No necesitas saber programar. Solo necesitas descargar el «reproductor» y elegir la «música». Aquí tienes las herramientas más amigables para empezar.

LM Studio: Es la favorita de muchos. Su diseño recuerda a una tienda de aplicaciones.

Descarga e instala: Ve a su web oficial y baja el instalador para Windows o Mac.

Busca el modelo: Al abrirlo, verás una lupa a la izquierda. Escribe «Llama 3» o «Phi 3».

Elige y descarga: Verás varias opciones. Busca las que tengan una barra verde (significa que tu PC puede con ellas). Dale a «Download».

A chatear: Ve al icono de la burbuja de chat. Selecciona el modelo que bajaste arriba y empieza a escribir. ¡Listo!

GPT4All:Si tu ordenador no es el más nuevo, prueba esta opción. Es muy robusta y fácil de usar.

Instalación simple: Tiene un instalador de «un solo clic».

Menú de descarga: Al abrirlo por primera vez, te muestra una lista de modelos recomendados.

Funcionamiento: No requiere configuraciones extrañas. Simplemente eliges y hablas. Funciona muy bien usando solo el procesador principal (CPU).

¿Qué versión descargar?

Cuando busques modelos, verás números raros como «Q4», «Q5» o «Q8». No te asustes. Esto se llama cuantización. Es como la compresión de una imagen JPG.

- Q4 (Recomendado): Es el equilibrio perfecto. Ocupa poco espacio y es muy inteligente.

- Q8: Máxima calidad, pero ocupa mucho y es más lento.

- Q2: Muy rápido, pero la IA puede decir incoherencias.

Para tu primera experiencia con IA local, baja LM Studio, busca «Llama 3» y elige una versión que diga «Q4». Tendrás a uno de los cerebros más potentes del mundo funcionando en tu portátil en menos de 10 minutos.Consejo: Si vas a probar esto, asegúrate de tener al menos 8GB o 16GB de RAM para una experiencia fluida.

¿Es seguro instalar una IA local? Riesgos y precauciones

La IA local te da privacidad, pero también te da responsabilidad. En la nube, Google o Microsoft protegen el sistema. Aquí, el administrador eres tú.

No te alarmes. Es seguro si sigues reglas básicas. Sin embargo, debes conocer estos tres riesgos principales antes de empezar.

Cuidado con lo que descargas (El riesgo de Malware)

Este es el punto más importante. Un modelo de IA es un archivo. Como cualquier archivo descargado de internet, puede contener virus.

En el mundo de la IA, existen dos formatos principales:

- Archivos

.pickleo.binantiguos: Pueden ser peligrosos. Tienen capacidad de ejecutar código en tu PC al abrirse. Evítalos si no confías en la fuente. - Archivos

.safetensors: Como su nombre indica, son seguros. Es el estándar moderno. Solo contienen datos, no código ejecutable.

Regla de oro: Descarga siempre modelos en formato

.safetensorsy usa fuentes reputadas como Hugging Face o las bibliotecas oficiales de LM Studio.

Estrés para tu hardware (Calor y Batería)

Ejecutar una IA local es intenso. Es como correr un videojuego de última generación.

- Temperatura: Tu procesador (CPU) o tarjeta gráfica (GPU) trabajarán al 100%. Si tu portátil no tiene buena ventilación, se calentará mucho.

- Batería: Si usas un portátil desconectado, la batería volará. El consumo energético es alto durante la generación de texto.

Riesgos de los modelos sin filtros (Uncensored)

Aunque verás modelos etiquetados como «sin censura», su uso conlleva riesgos técnicos importantes. Al eliminar las barreras de moderación, estas IAs suelen volverse inestables e incoherentes.

No confundas falta de filtros con mayor inteligencia. Estos modelos tienden a «alucinar» datos y pueden generar respuestas tóxicas o sin sentido. Por tu seguridad y para garantizar resultados profesionales, te recomendamos usar siempre las versiones «Instruct» o «Chat». Estas variantes están afinadas para ser asistentes útiles, precisos y fiables.

El espacio en disco

Parece obvio, pero sorprende. Un modelo de buena calidad ocupa espacio.

- Un modelo pequeño ocupa unos 4 GB.

- Uno potente puede superar los 20 GB o 40 GB. Si llenas tu disco duro al máximo, tu ordenador irá más lento en general.

Conclusión sobre seguridad: usar IA local es seguro si usas herramientas como LM Studio y archivos .safetensors. Simplemente vigila la temperatura de tu equipo y descarga solo de sitios oficiales.

Consejo: Si vas a probar esto, asegúrate de tener al menos 8GB o 16GB de RAM para una experiencia fluida.

Casos de uso real para la IA local

¿Para qué sirve todo esto? No es solo para chatear. La utilidad práctica es inmensa.

- Fotografía Computacional: Tu móvil mejora fotos pixeladas. Lo hace en milisegundos sin internet.

- Resumen de Reuniones: Graba un audio y tu PC lo transcribe. Luego hace un resumen privado. Ningún dato sale de la sala.

- Asistentes de Código: Los programadores usan modelos locales para autocompletar código. Protegen su propiedad intelectual.

- Salud Personal: Monitorización de constantes vitales en relojes inteligentes. Detectan anomalías sin compartir tu historial médico.

Desafíos y el futuro de la IA en el borde

No todo es perfecto. La IA local tiene límites. La batería se agota más rápido si abusas del procesador. El almacenamiento también es un reto. Los modelos ocupan espacio.

Sin embargo, la tendencia es clara. Veremos modelos híbridos. El dispositivo hará lo fácil. La nube hará lo difícil. Esta colaboración será invisible para el usuario.

Las «Small Language Models» (SLM) seguirán mejorando. Pronto, tu nevera o tu coche tendrán una inteligencia sorprendente. La dependencia de la nube disminuirá. Ganaremos en libertad digital.

La IA local no es una moda pasajera. Es la evolución natural de la computación. Nos devuelve el control de nuestra información. Nos ofrece velocidad y fiabilidad.

Las marcas como Apple, Qualcomm y Meta están pavimentando el camino. Tener un dispositivo capaz de ejecutar IA es una inversión inteligente. El futuro es privado, rápido y está en tu bolsillo.

¿Estás listo para desconectarte de la nube?

Te puede interesar:

La revisión, edición final y control de calidad han sido realizadas por personas. Contenido revisado y editado por el equipo editorial de Beyra Magazine.